Мария Тихонова, куратор направления ИИ на RuCode 4.0, отмечает, что при обучении больших языковых моделей существуют стандартные проблемы обучения больших нейросетей: необходимо много мощностей, времени и ресурсов, для чего нужны большие суперкомпьютеры и сотни GPU. Маленькие компании не могут этого позволить, однако в открытом доступе есть многие модели, в том числе русскоязычные, например, в популярной библиотеке HuggingFace. Также NLP очень сильно завязано на язык, поэтому методы и алгоритмы, которые работают для английского, могут быть неприменимы для других языков. В русском языке присутствует свободный порядок слов и большое число словоформ, что влияет на качество моделей и на выбор алгоритмов. Для русского языка для нормализации слов применяют лемматизацию – перевод слов к их нормальной словарной форме. Так, для существительных это будет слово в мужском роде и именительном падеже. Для английского работает метод стемминга, при котором исходная словоформа обрезается до его основы. Помимо этого, на качество моделей оказывает влияние количество данных для обучения, объемы текстов в открытом доступе различаются, так, хотя русскоязычных текстов достаточно много, их меньше, чем англоязычных.

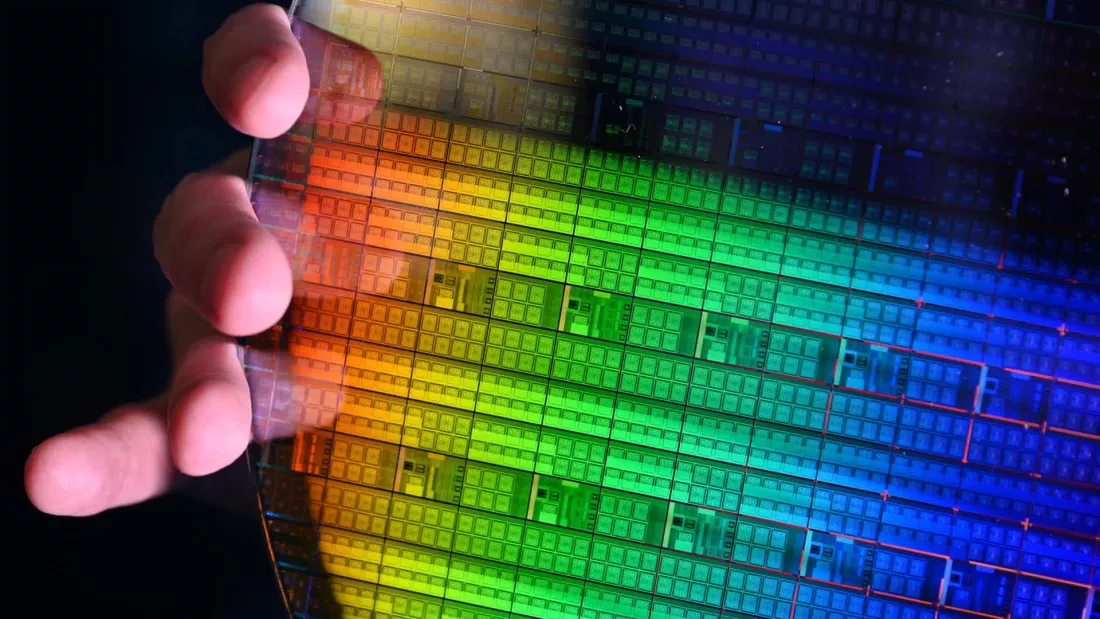

Новое исследование Intel намечает курс на разработку чипов с триллионами транзисторов к 2030 году

Исследования Intel включают разработки с материалами толщиной не более трех атомов, «вертикальную» память, и глубокое понимание дефектов интерфейса, влияющих на хранение и извлечение квантовых данных.